Manual de usuario del módulo Asistentes de IA para Dolibarr

18 minutos de lectura

Este módulo que puedes comprar en Dolistore te ofrece la posibilidad de poder usar muchos modelos de IAs generativas desde tu propio Dolibarr consumiendo lo mínimo a través de las APIs de los diferentes proveedores, en lugar de contratar pagos fijos mensuales por cada empleado de tu empresa.

Índice

Si no eres un usuario administrador en tu Dolibarr, puedes pasar al punto 3 de esta manual.

- Proceso de instalación

- Integración con proveedores de IA

- OpenAI.com (generación de texto)

- Anthropic.com (generación de texto con visión)

- Perplexity.ai (gen. de texto y búsqueda en internet)

- Fal.ai (gen. de imágenes con FLUX y StableDifussion)

- Conversar con una IA

- Próximamente

- Acceso a DEMO

1. Proceso de instalación

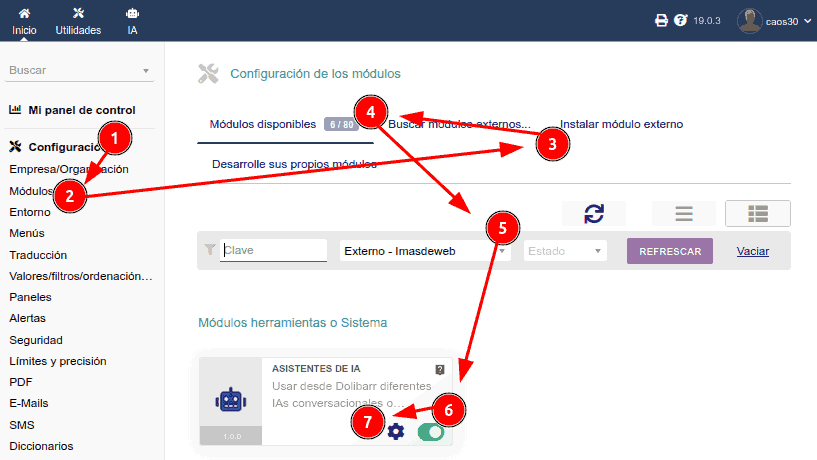

Primeramente lo de costumbre en la instalación de cualquier módulo de Dolibarr:

- Ir a la sección Configuración

- Ir a Módulos

- Ir a pestaña Instalar módulo externo, y ahí subes el ZIP del módulo o su actualización

- Volvemos a la pestaña Módulos disponibles

- Filtramos por Origen: "Externo - IMASDEWEB"

- Activamos el módulo

- Pulsamos sobre el icono de Configuración

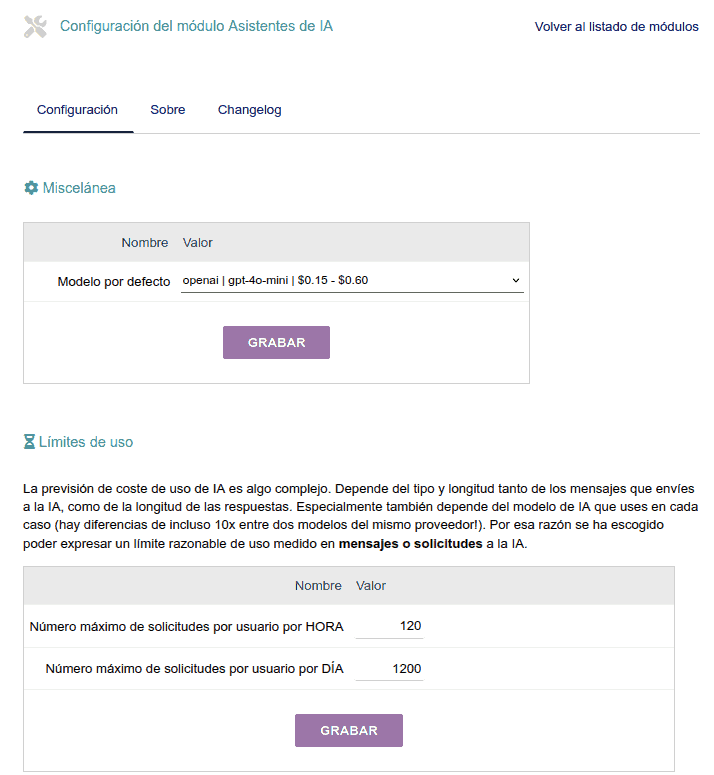

En un primer apartado Miscelánea podemos configurar cosas como el "Modelo por defecto". Este será el modelo con el que se iniciará un chat cuando el sistema no tenga en la variable de sesión del usuario información de cuál es el último modelo que usó.

Límite de uso por usuario

Puedes configurar el límite de uso por usuario, tanto por hora como por día:

- Cada vez que un usuario hace una solicitud de IA, el sistema cuenta cuantas solicitudes hizo en los últimos 60 minutos, y también en las últimas 24 horas. Y si algunos de esos valores superan el límite correspondiente entonces le muestra un mensaje al usuario animándole a que pruebe más tarde.

- Según lo grande de tu organización y el tipo de uso que harán o necesitan hacer tus usuarios/empleados, te convendrá configurar estos dos parámetros de manera diferente.

Por ejemplo, tal vez, no quieres que un usuario no pueda hacer un uso muy intensivo de la IA (generando textos, imágenes, etc.) durante un par de horas. Entonces puedes configurar un límite por hora alto (por ejemplo, una solicitud cada 10 segundos serían 6 por minuto y 360 por hora. Pero como no quieres que eso aliente a que lo usen demasiado, podrías poner un límite de solamente 1400 cada 24 horas. De ese modo permitirías usos intensivos de la IA, garantizando cierto control sobre un uso abusivo prolongado.

2. Integración con proveedores de IA

Esta es la parte más interesante y que irá variando más frecuentemente con cada actualización. A lo largo de los siguiente meses se añadirán más y más integraciones con nuevos proveedores o con nuevos modelos de mismos proveedores. Así que si quieres sacarle el máximo partido a esta materia, sería recomendable actualizar regularmente.

Para configurar cada proveedor:

- Abre una cuenta en la plataforma del proveedor (el enlace aparece en el panel)

- Genera una clave única para usar la API de ese proveedor y la colocas aquí

- Indicas qué modelos de ese proveedor quieres:

- PERMITIT SU USO a los usuarios

- VISUALIZAR a los usuarios **

** En algún caso podría interesar mostrar algún modelo que no está abierto para ser usado, pero que estás dispuesto a habilitarlo si alguien lo necesita. Porqué ciertamente hay modelos bastante caros para ser usado con normalidad, pero que pueden resultar muy útiles activarlos en momentos puntuales.

Nota: a futuro está previsto implementar la posibilidad de que habilites/deshabilites los modelos POR USUARIO. De este modo tendrás mayor control sobre quien consume cada servicio de IA.

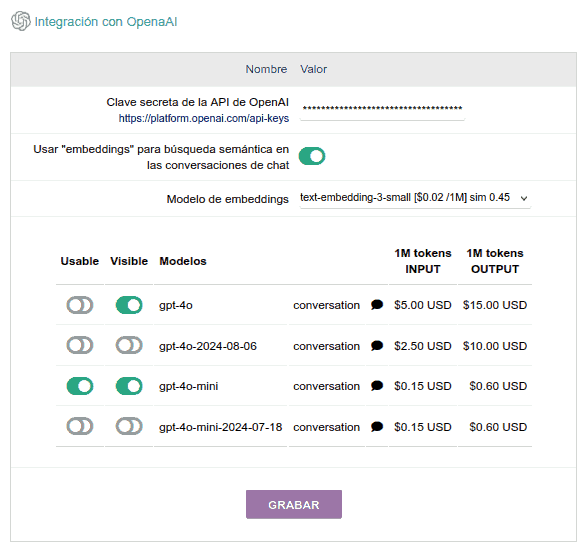

OpenAI.com

- Es la empresa creadora del famoso chatGPT, que tiene una particularidad: tiene modelos para EMBEDDINGS, que es un servicio de IA fundamental para desarrollar cualquier sistema de búsqueda semántica, es decir que un usuario busque "felinos" y el sistema le encuentre cualquier cosa relacionada con gatos y otros felinos, incluso aunque la palabra a buscar se haya escrito mal.

Este sistema de embeddings es el que se va a usar para el buscador en el historial de los chats de cada usuario, en un futuro muy próximo. Realmente es una funcionalidad que se va a implementar como OPCIONAL, pero ciertamente vale mucho la pena y es baratísimo el consumo de este tipo de IA de embeddings, por eso te lo recomiendo enormemente. Puede incrementar tu consumo de IA en un 1% apenas, pero lo que obtienes a cambios es radicalmente provechoso.

- Los modelos de texto tienen precios diferentes para el INPUT (lo que escribe el usuario, incluído cualquier documento que adjunte) que para el OUTPUT (la respuesta del modelo).

- El consumo se mide en MILLONES DE TOKENS. Los "tokens" son "una parte de una palabra" y equivalen aproximadamente a una o dos sílabas humanas. Entonces un millón de tokens equivale como a más de DOS MIL PÁGINAS DE UN LIBRO medio. Así que es bastante económico el uso de estas IAs.

Nota: En una conversación con IA, cada nuevo mensaje incluye todos los anteriores. Esto permite que la IA "recuerde" el contexto, pero aumenta exponencialmente el consumo de recursos a medida que la conversación avanza, ya que la IA relee todo el historial en cada interacción.

La recomendación es que cuando tengas que cambiar de tema abras una nueva conversación.

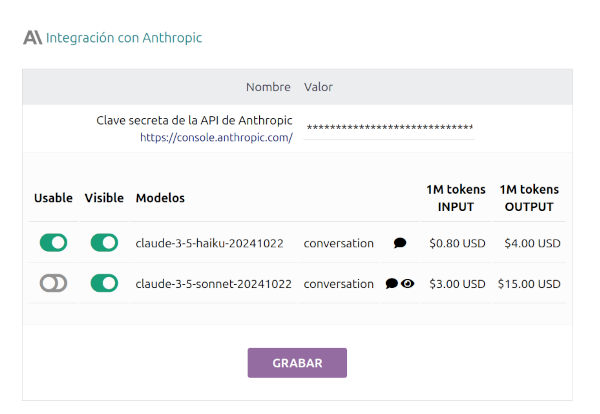

Anthropic.com

Anthropic es la empresa detrás de los modelos Claude, que par a mi gusto a fecha de hoy son los más competentes para cuestiones de generación de código, traducción multlingüe y estructuración de contenidos de texto:

- Para "trabajar con textos y generando textos", que funciona a como estamos acostumbrado a lo que hace chatGPT:

El modelo responderá en base a toda la información con la que ha sido entrenado, la cuál tiene una fecha límite concreta. Más allá de la finalización de su fecha de entrenamiento, estos modelos no tienen acceso a información actualizada.

El modelo Haiku que es el más económico es bastante bueno para el 90% de las tareas que se le pida. El modelo Sonnet es brillante, pero cuesta unas 4 veces más por millón de tokens.

- Para "VER el contenido en imágenes", es decir, que en la conversación de chat podemos adjuntar imágenes para que las "vea" y nos responda consultas sobre ello. Por ejemplo: interpretar tablas o gráficos estadísticos, o leer fórmulas químicas, o problemas matemáticos de geomtería, etc.

Esta habilidad de VISION solamente la tiene el modelo Sonnet. Verás que en el módulo se señalan con el icono de un OJO los modelos que tienen esta capacidad de VISION.

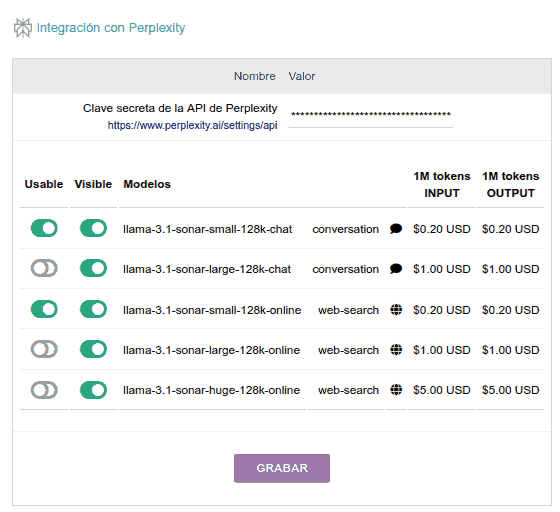

Perplexity.ai

Perplexity es un proveedor fabuloso de búsqueda en internet usando IA, que integra en sus servidores diferentes modelos opensource de diferentes proveedores. En concreto, a través de su API, a día de hoy ofrece la familia de modelos Llama 3.1 de Meta para usar en dos modalidades :

- Simplemente para "chatear", que funcionaría como estamos acostumbrado a lo que hace chatGPT.

Es decir, que el modelo responderá en base a toda la información con la que ha sido entrenado, la cuál tiene una fecha límite concreta. Más allá de la finalización de su fecha de entrenamiento, estos modelos no tienen acceso a información actualizada.

- Para "buscar en línea", que es algo bastante diferente: busca en internet (usando Bing) información de interés a nuestra pregunta y construye una "buena respuesta".

Obviamente la calidad de la respuesta depende mucho de la calidad de los resultados de búsqueda.

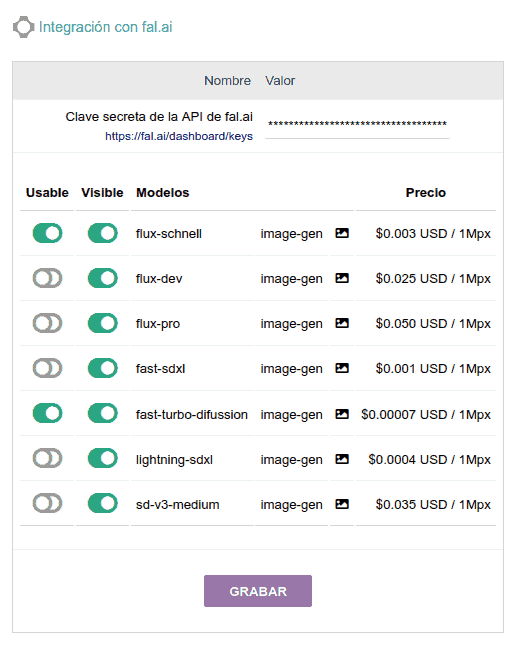

fal.ai

FAL.AI es una empresa que nos permite acceder por API a sus servidores para usar modelos de generación y edición de imágenes y/o video de terceros. En concreto en este módulo para Dolibarr estaremos usando:

- La familia de modelos FLUX, que aparecieron a principios de 2024 y por unos meses fueron los mejores generando imágenes foto-realistas que incluyen texto escrito (en carteles, gorras, camisetas, automóviles, etc.), aunque sobre todo en INGLÉS. En otros idiomas no lo hace tan bien, especialmente si son frases largas o palabras que "no están en el diccionario", como nombres de empresas o marcas no conocidas. En verano, el modelo Ideogram 2.0 (que es de otra empresa) superó a FLUX en su habilidad para incluir texto en las imágenes, y a día de hoy (Noviembre 2024) sigue siendo la única que lo hace bien el 80% de las veces que lo intenta en idiomas que no son el inglés.

Aunque ya salieron los modelos FLUX.1 en fal.ai solo nos ofrecen usar los FLUX iniciales, que de todos modos son muy buenos generando imágenes con texto:- flux-schnell: el más económico... unas 300 imágenes por $1 USD !!!!

- flux-pro: calidad máxima, aunque por $1 USD podrás generar "solo" 20 imágenes de super-calidad

- flux-dev: el modelo intermedio...unas 40 imágenes por $1USD - También puedes usar algunos de los modelos de Stable Difussion, que es un veterano en este asunto de generar imágenes, en concreto estos modelos:

- fast-turbo-difussion: 14 mil imágenes por $1 USD !!!

- sd-v3-medium: 30 imágenes por $1 USD.

Nota: estos modelos son muy buenos con dibujos vectoriales y dibujos artísticos, cómics, etc. No tanto con las imágenes foto-realistas, a menos que los uses con LORAS. Pero esto ya se escapa al objetivo de este módulo. Si te interesa esto te recomiendo que uses StableDifussion desde la interfaz web de fal.ai.

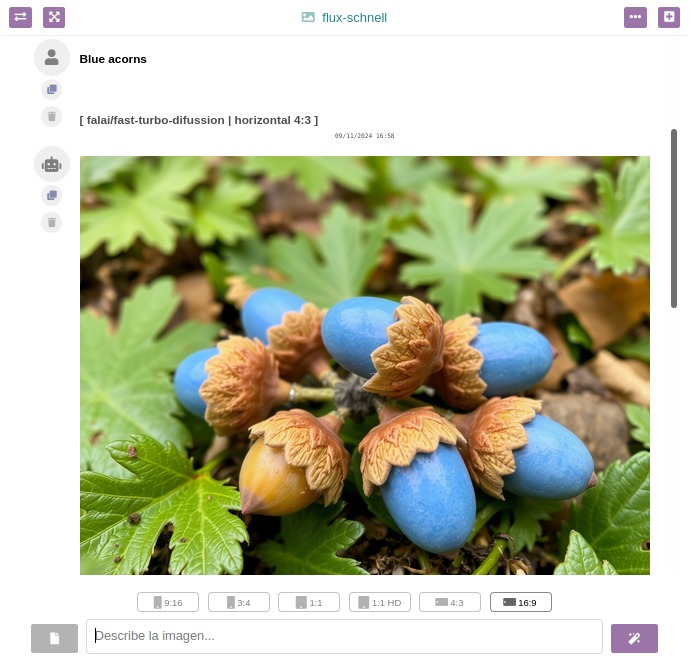

Detalles técnicos en cuanto a la generación de imágenes

- Las imágenes que los usuarios de tu Dolibarr vayan generando en sus conversaciones quedarán almacenadas en /documents/1/99 (donde "1" es el ID de usuario, y "99" el ID de cada chat en cuestión). Más adelante implementaré alguna manera de poder controlar cuánto espacio van ocupando las imágenes generadas. Apróximadamente ahora pesan entre 500Kb y 1Mb, dependiendo de las dimensiones y del modelo.

- He programado el módulo para que sea fácil compartirse las imágenes entre usuarios de Dolibarr: si se pasan el enlace de la imagen (puedes obtenerlo abriendo la imagen en una pestaña nueva) pueden descargarse la imagen siempre y cuando tengan sesión iniciada.

- Igual que con los modelos de chat y de búsqueda, en una misma conversación pueden usarse diferentes modelos: es decir, puedes cambiar a un modelo de generación de imágenes a media conversación con cualquiera de los modelos de texto para generar unas cuantas imágenes.

- En cualquier caso, los modelos que generan imágenes no tienen en cuenta para nada los otros mensajes de esa conversación, y del mismo modo, las imágenes generadas tampoco se tienen en cuenta por los modelos de texto, aunque estén en la misma conversación.

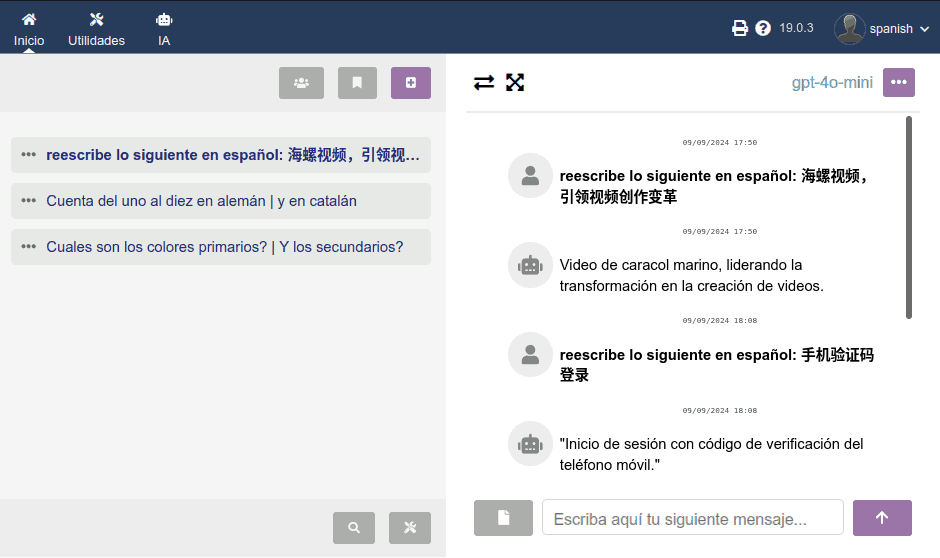

3. Conversar con una IA

Al acceder a la sección IA del menú superior, veremos una pantalla como la siguiente, que será dónde cada usuario:

- "conversará" con los diferentes modelos de IA

- interactuará con su historial de conversaciones

Es una interfaz sencilla de dos paneles:

- Panel izquierdo: historial de conversaciones

- Panel derecho: conversación

No quiero alargar esta guía innecesariamente, creo que casi todas las funciones y botones son bastante obvios, así que comentaré nada más lo más relevante. Si crees que algo no queda respondido, por favor deja un comentario abajo de todo para que complemente esa información acá. Gracias!

Elementos gráficos

- Los botones en escala de grises son botones de funciones previstas de implementar próximamente. En sucesivas actualizaciones se irán activando.

- La forma básica de trabajar es pulsando el botón "+" para iniciar una nueva conversación, o bien pulsar sobre cualquiera del historial para continuar con ella.

- En el panel derecho tienes un botón para ocultar el panel izquierdo.

- En el panel derecho tienes un botón para "maximizar" el área de chat:

1. oculta el panel izquierdo

2. oculta la barra superior de menús de Dolibarr

3. maximiza tu ventana del navegador - Cuando redactes un nuevo mensaje, puedes usar la tecla INTRO/ENTER para agregar saltos de línea, y puedes usar la tecla TABULADOR para posicionar el foco en el botón de ENVIAR MENSAJE. De este modo puedes mantener una conversación sin levantar la mano del teclado.

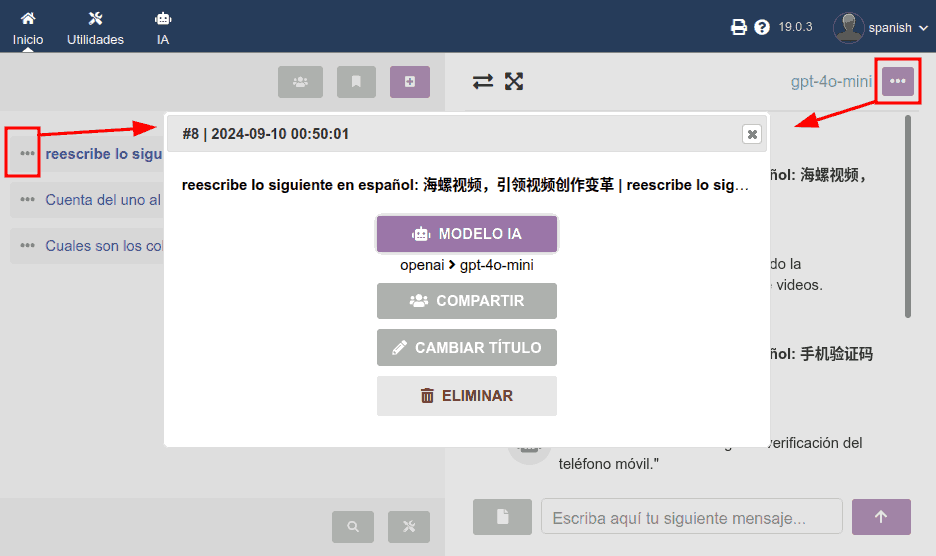

Opciones de un chat

Al pulsar sobre cualquier icono del tipo tres puntos (···) emerge una ventana modal (popup) con:

- el ID numérico de la conversación

- la fecha de inicio de la conversación

- el modelo de IA activo o usado en el último mensaje de ese chat (recuerda que en cada mensaje de un mismo chat puedes usar diferentes modelos!)

- botón para compartir (próximamente)

- botón para cambiar el título en el historial (próximamente)

- botón ELIMINAR (ya funciona!), que te pedirá confirmación antes de eliminar

Selección de modelo de IA

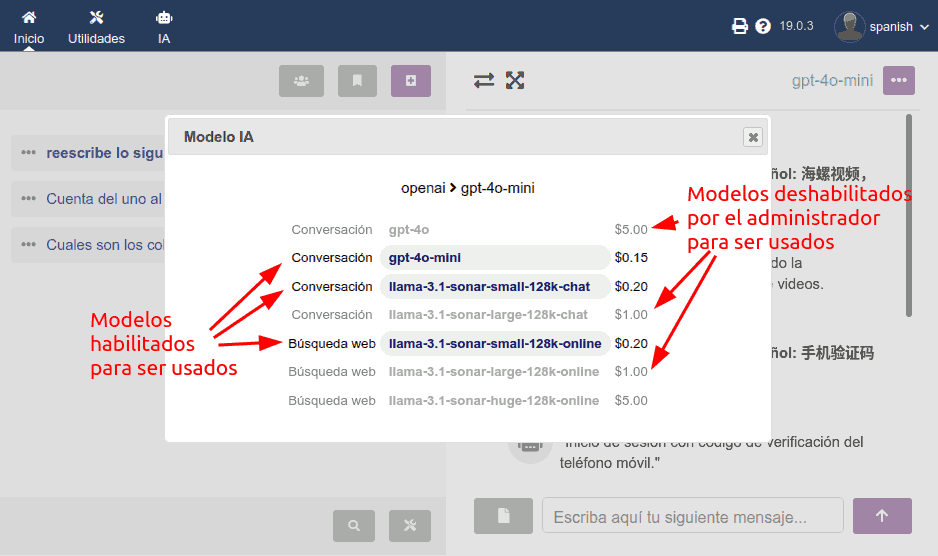

Al pulsar sobre el anterior botón "Modelo IA" emerge un segundo recuadro de diálogo:

- con la lista de modelos que el administrador haya configurado como VISIBLES en el panel de administrador

- aparecen desactivados los modelos que se configuraron como VISIBLES pero NO USABLES

- he decidido incluir el precio para hacer copartícipe a los usuarios finales de la diferencia (grande!) de precio entre usar un modelo u otro, y fomentar un uso responsable

Nota: ahora mismo solo hay modelos de generación de texto, pero próximamente habrá modelos de generación de imágenes, de transcripción de audio, etc.

Próximamente

Más integraciones con proveedores de IA

Si has estado al tanto de esta revolución tecnológica que estamos viviendo con las "IAs generativas" sabes que cada semana aparecen novedades. Así que mi voluntad es la de agregar integración que más y más modelos y proveedores de modelos. La idea es que desde un mismo panel (desde nuestro Dolibarr) tengamos una base sólida desde donde beneficiarnos de estas IAs, en un entorno multisuario.

- transcripción multi-idioma de audios (con Whisper de OpenAI)

- generación de videos (esto va a explotar antes de fin de 2024!)

- generación de audio a partir de texto (OpenAI, Azure Cognitive Services?)

Interactuar con la base de datos de Dolibarr

Además, obviamente, también ando ya viendo cómo podría integrarse en estas conversaciones con la IA el acceso a los datos almacenados en nuestra base de datos, ya sea para:

- analizar tendencias

- resumir o recuperar datos de clientes, proyectos, productos, etc.

- comparar productos, pedidos, etc...

No cabe duda de que la IA puede sernos muy útil para interactuar con nuestros propios datos. Estaré trabajando en ello. Si tienes cualquier referencia útil de gente que ya tenga algo avanzado en eso, aunque sea en otro ERP, por favor, déjame la referencia en los comentarios!

Funciones de IA contextuales

También me gustaría poder agregar "botones rápidos de asistencia" en los diferentes listados y fichas de los objetos de Dolibarr, y en los editores de texto, con prompts pre-grabados del tipo:

- traducir al idioma X

- corregir gramaticalmente y mejorar un redactado (email, respuesta de ticket, etc.)

- resumir una tabla de datos (de facturas de un cliente, de producción, etc.)

Acceso a la DEMO

Añada su comentario: